子どもたちの間でも使われ始めている対話型生成AI。「学習支援」「創造活動」「遊び・相談」と用途も幅広い。若者の間ではChatGPTが「チャッピー」と呼ばれ人気。だが、アメリカでは16歳の少年がChatGPTとの対話の後に自死するなどの事例も起きており、子どもの利用に対する懸念も広がっている。

AI技術を活用したメンタルパートナーアプリを提供するAwarefy(アウェアファイ・東京)と、同社が運営する「こころの総合研究所」(以下「こころ総研」)は、2025年9月に実施した「未成年の子どもによる対話型生成AIの使用に関するアンケート調査」の分析結果を公開した。

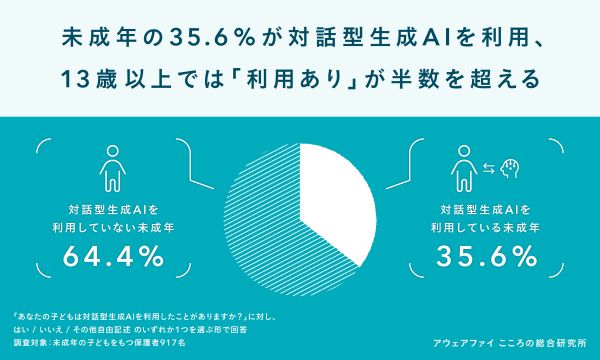

まず、未成年の子どもを持つ保護者に、子どもが対話型生成AIを利用したことがあるかを尋ねたところ、35.6%(326人)が「利用経験あり」と回答。利用率は年齢とともに上昇し、13歳以上(中学生以上)では半数以上が利用経験ありという結果となった。最年少の利用者は1歳だった。なお、回答者の中で最も利用率が高い「ChatGPT」は利用規約において13歳未満の利用を禁止しているが、同調査では13歳未満の子どもの26.0%が対話型生成AIを利用していることも明らかになっている。

また、保護者がAIを利用している家庭では、子どもがAIを利用している割合も高い傾向があった。保護者がAIを利用している場合、子どもがAIを利用している割合は33.4%なのに対し、保護者が利用していない場合は2.2%にとどまった。

利用頻度は、半数以上が週1回以上利用しており、最も多い利用頻度は「週2~3回」。利用目的は、「特定のテーマについて情報を集める」「勉強でわからないところを教えてもらう」などの学習・リサーチが最も多く、「趣味の話」や「雑談」など、話し相手としての利用も多く見られた。契約形態については、個人用のみの利用が84.3%、個人用と学校で支給されたものの両方を利用が5.9%、学校で支給されたもののみを利用が2.4%という結果に。学外での個人利用が約8割を占め、学校での安全管理が及ばない環境での利用が主流であることが明らかになった。

子どもの対話型生成AI利用について、保護者がどのような影響を感じているかを尋ねたところ、「特に影響はない」~「やや良い影響」という回答が多数を占めた。具体的には、学習の補助や情報収集に役立っているといった声が寄せられたが、一方で、約10%の保護者が「怖いと感じた瞬間」または「依存しているかもしれないと感じた瞬間」があると回答。割合としては少数だが、具体的な懸念として以下のような声も寄せられている。「個人情報や自身の画像などを安易に入力してしまう」「回答を疑うことなく信じてしまう・うのみにしてしまう」「間違った情報を信じて行動に影響していると怖いと思った」。

保護者が最も気になる点として、「AIとやりとりしている内容」が挙げられ、求める対策としては「適切な利用方法について子どもが学ぶ機会の提供」「有害なコンテンツへのアクセス制限」「やりとりの内容を保護者がモニタリングできる機能」が上位となった。

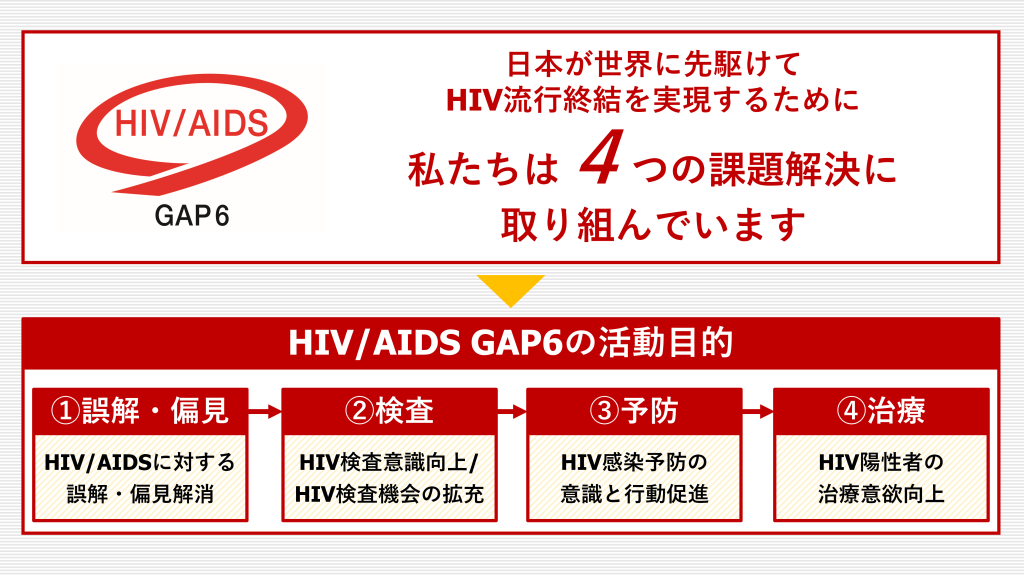

文部科学省のガイドラインでは、学校現場において留意すべきリスクとして、AIに人格があるかのように誤認するリスク、AIに依存したりAIの答えをうのみにすることで能力の育成が妨げられるリスク、機密情報や個人情報に関するリスク、著作権の侵害に関するリスクなどを挙げている。

今回の調査結果であげられた保護者の懸念と、ガイドライン上で挙げられているリスクは一致しており、今後AIを利用する子どもがますます増えることを考えると、事業者だけでなく、利用者、専門家、そして社会全体で子どものAIの適正利用について考え、実践していく必要があるだろう。

米国心理学会(APA)は、未成年のAI利用は大人とは異なる影響がある可能性が高いと指摘しており、専門家監修のサービスなど、児童青年向けに適切に設計されたAIシステムや、目的に特化したAI利用が望まれている。アウェアファイでは、未成年者が利用する際には保護者等の同意を得ることを利用規約で定めているが、今回の調査結果をふまえ、今後は利用者の年齢に応じた注意喚起の強化など、安全性に配慮したさらなる取り組みをしていく予定だという。